THINK Lab : Quand l’IA fait le job : Manager, augmenté ou dépassé ?

A la une

Recherche

THINK Lab

Zoom sur le THINK Lab

Le THINK Lab : de quoi s’agit-il ?

Un espace d’échange et de réflexion rassemblant des partenaires de l’écosystème, des universitaires et alumni pour émettre des propositions prospectives pour les entreprises. Accueillant une trentaine de participants, le THINK Lab travaille sur des thématiques annuelles au cours d’ateliers d’intelligence collective où chacun contribue avec son expérience et son regard.

Pourquoi créer un THINK Lab ?

D’abord parce que l’université est dédiée à la construction de la pensée et de la réflexion ouverte et constructive à partir de débats d’idées. Lorsque la richesse des parcours de chacun rencontre le monde académique, il possible d’ouvrir des voies innovantes, qui feront progresser à la fois la connaissance et l’action concrète dans la cité. En second lieu, la formation en management s’adresse au monde professionnel en constante évolution. Comment former les étudiants, sans prendre le pouls de ceux qui vont les recruter et partager leurs parcours professionnels ?

Le THINK Lab donne l’opportunité de rapprocher des mondes qui se côtoient sans véritablement se donner le temps de s’écouter et se comprendre.

Comment travailler ensemble ?

Le THINK Lab est bâti sur le principe de la co-construction : les temps d’échanges, de reformulation et de restitution partagée permettent de stimuler l’idéation tout en s’assurant de l’adhésion du plus grand nombre.

Quand l’IA fait le job : Manager, augmenté ou dépassé ?

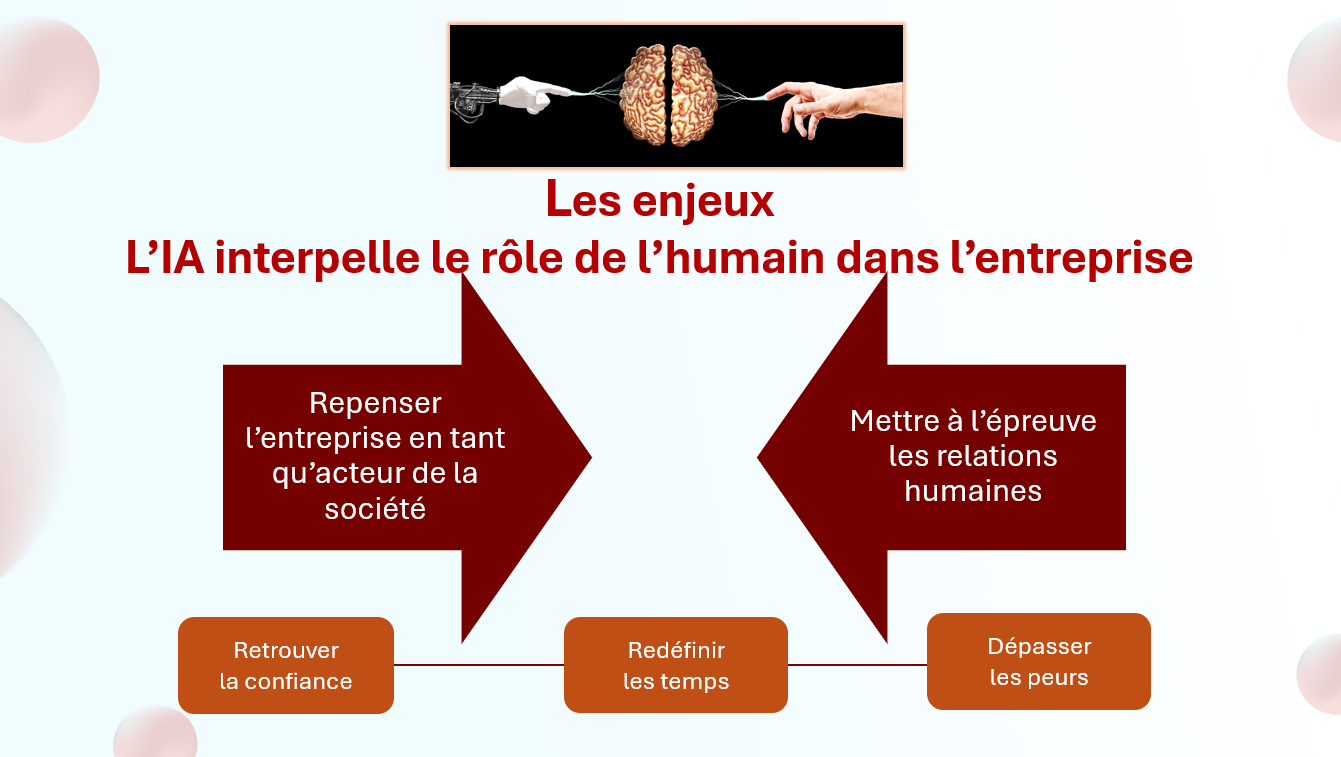

Constats et enjeux

L’IA n’est pas seulement un outil opérationnel, elle transforme la mission même de l’entreprise. Les décisions prises par les dirigeants doivent s’inscrire dans une vision soutenable.

Cet enjeu soulève une question centrale : comment intégrer l’IA de manière éthique et responsable afin d’en faire un levier de progrès, plutôt qu’un simple outil d’optimisation ? La responsabilité sociétale des entreprises (RSE) joue ici un rôle clé dans la définition d’un cadre adapté.

Les participants au THINK Lab ont souhaité éclairer la question de l’IA en s’interrogeant sur le rôle qu’aura l’humain à l’avenir. Les changements qui se profilent dépassent le champ opérationnel : les systèmes décisionnels, les missions des organisations, les modalités de régulation vont être profondément revus.

Les discussions ont révélé deux axes de réflexion complémentaires :

- L’un s’attache au rôle de l’entreprise en tant qu’acteur de la société : comment l’IA va-t-elle remettre en question les business modèles, voir même le modèle de l’entreprise par rapport à ses ambitions et à la valeur proposée ?

- L’autre concerne les relations humaines qui s’exposent à une dénaturation en raison de fait : qui porte la relation l’humain ou l’IA ? Quelles compétences pour l’humain ? Pour l’IA ? Quelle prise de recul sur ce qu’apporte l’IA dans nos montées en expertises ?

Toutes ces questions ont animé les discussions ; elles témoignent de la vigilance de chacun sur ce qu’implique l’arrivée de l’IA au cœur des organisations.

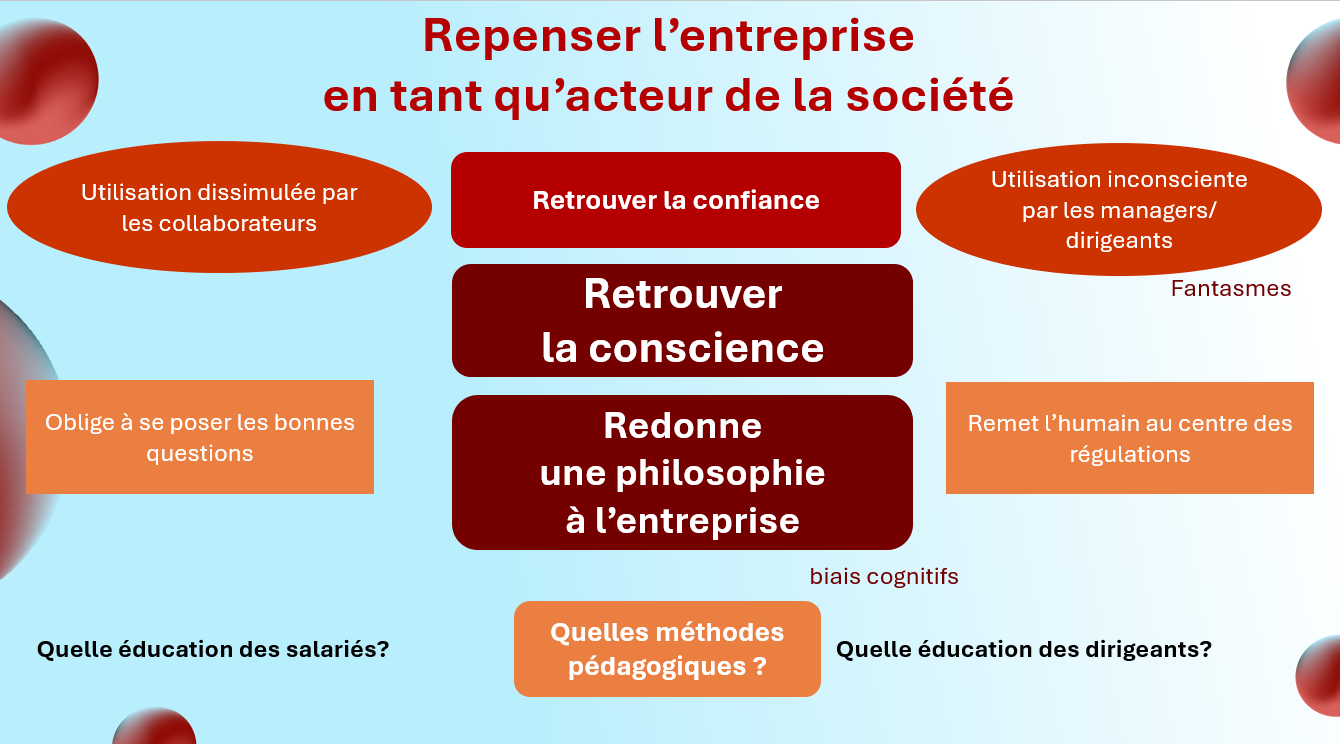

Repenser l’entreprise en tant qu’acteur de la société

Retrouver la conscience

Pour le dirigeant, la pleine conscience du projet entrepreneurial conditionne la réussite de l’introduction de l’IA. En assumant ce que chacun fait de ce nouvel outil, et jusqu’où prend-t-il sa place dans la vie professionnelle ?

Dans quelle mesure l’entreprise doit-elle assumer un rôle actif dans la transformation de la société ? En intégrant des concepts tels que la confiance, la conscience et la philosophie d’entreprise, nous avons mis en lumière un enjeu central du management contemporain : la nécessité de dépasser une logique purement économique pour embrasser une vision plus globale et responsable.

Un contexte de transformation profonde

L’essor de l’intelligence artificielle, introduit des changements radicaux dans la manière dont les entreprises fonctionnent et prennent des décisions. Ces outils, bien que porteurs de promesses en termes de performance et d’innovation, soulèvent des questions éthiques et organisationnelles. Le risque d’une utilisation opaque ou inconsciente, évoqué ici, renvoie à la problématique plus large de la transparence technologique et de la responsabilité des entreprises vis-à-vis de leurs parties prenantes.

L’IA ajoute de la complexité aux enjeux RSE.

Le défi de l’éducation et du leadership dans un monde en mutation

L’un des axes forts de nos échanges pose la nécessité de repenser la formation et surtout l’éducation des acteurs de l’entreprise, qu’il s’agisse des salariés ou des dirigeants. Cette réflexion dépasse les débats sur l’évolution des compétences et des mentalités ; il s’agit davantage de valeurs et de déontologie.

- Les salariés doivent être préparés à travailler aux côtés de l’IA sans en être totalement dépendants. Cela suppose une approche pédagogique qui ne se limite pas à l’apprentissage technique, mais qui intègre également une réflexion critique sur l’usage de ces technologies. En amont, quelle préparation ont-ils eue ? Quels échanges sur les enjeux et les risques d’aspiration des données ?

- Les dirigeants ont, quant à eux, la responsabilité de fixer un cadre éthique clair et de définir une vision stratégique qui prenne en compte les enjeux humains et sociétaux. Ce qui implique une compréhension fine des transformations sociales et technologiques en cours et surtout une lucidité.

Vers une entreprise plus consciente et engagée ?

L’entreprise peut-elle devenir un espace de réflexion et de transformation sociétale ? Au-delà de son rôle économique, elle est aujourd’hui de plus en plus sollicitée pour jouer un rôle dans la régulation des usages technologiques, la protection des données et l’accompagnement du changement social.

Finalement, la diapositive met en lumière une tendance de fond : le management de demain ne pourra plus être seulement une affaire de rentabilité et de stratégie, mais devra aussi intégrer une dimension éthique et éducative.

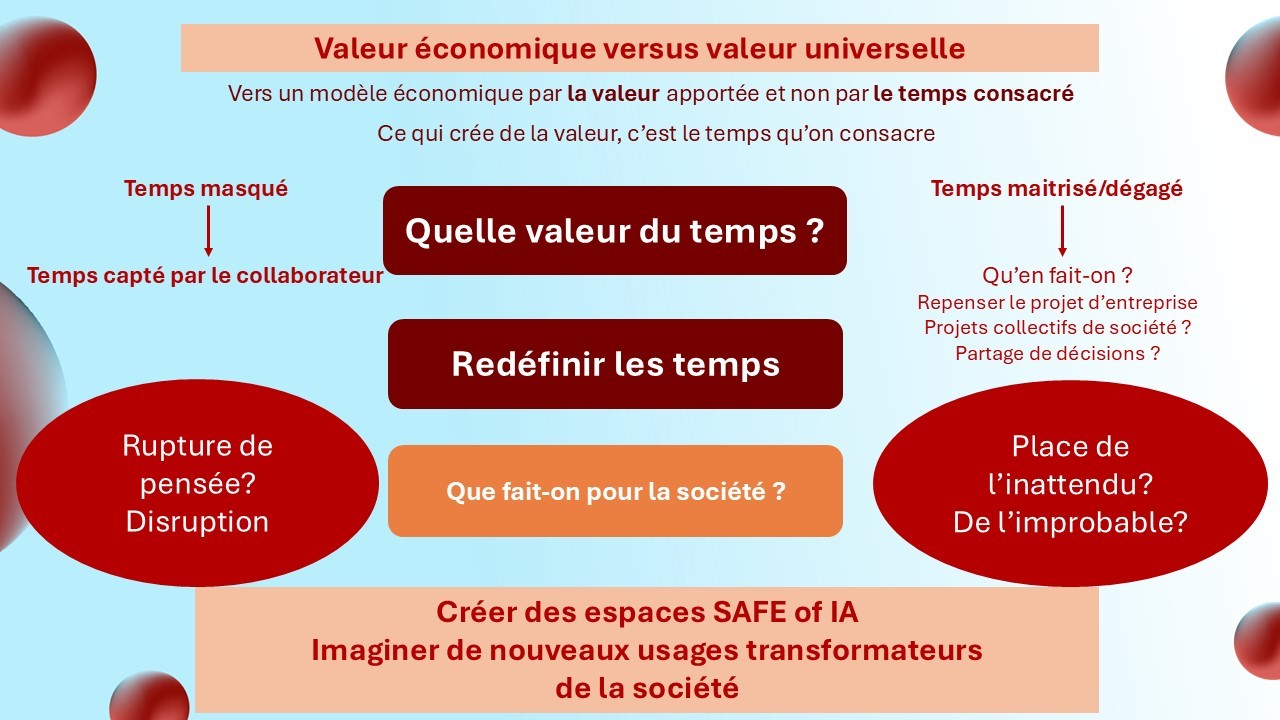

Redéfinir les temps

L’IA bouscule le rapport aux temps : accélération, durée des apprentissages, des vérifications, dérégulation des délégations, transformation des systèmes de contrôle… Surtout, les usages de l’IA effacent les tâches systématiques et avec elles, l’implication de l’humain dans l’activité. L’uniformisation des pratiques et derrière des modes de pensée ne risquent ils pas de faire disparaitre la créativité ?

Un modèle économique en transformation

Historiquement, l’économie s’est structurée autour de la productivité du travail humain : plus on consacre de temps à une tâche, plus elle produit de valeur. Cependant, avec la montée en puissance de l’IA et des outils numériques, ce paradigme est remis en cause. Aujourd’hui, la valeur est souvent définie par l’impact et l’innovation, plutôt que par la quantité d’effort ou le temps investi.

Cela pose alors la question : quels sont les nouveaux critères d’évaluation du travail et de la performance dans un monde où l’IA peut automatiser une partie des tâches ?

- Le temps masqué : une part du temps des collaborateurs est “captée” par l’utilisation cachée de l’IA. Ce phénomène soulève des questions sur l’efficacité réelle du travail. Que faire ce temps libéré par l’utilisation de l’IA à l’insu du cadre officiel de travail ? Que faire de cette distorsion ? Cet espace de liberté gagnée pourrait-il offrir aux collaborateurs une opportunité de créativité qui lui serait propre ?

- Le temps maîtrisé/dégagé : à l’inverse, la technologie pourrait permettre de libérer du temps pour des activités à plus forte valeur ajoutée, comme la réflexion stratégique, l’innovation ou la collaboration interne versus externe.

L’enjeu est donc de repenser les organisations pour que le temps gagné par l’automatisation puisse être réinvesti de manière constructive, collective, plutôt que simplement absorbé dans une logique d’optimisation et de rentabilité à court terme. A la différence des autres innovations technologiques, ciblées sur certaines formes de productivités, l’IA propage ses apports à l’ensemble de l’organisation de manière autant horizontale que verticale bouleversant les process et les agencements de compétences.

Vers un nouveau rapport au temps et à la société

Trois pistes majeures émergent :

- Repenser les projets d’entreprise : si le temps n’est plus une contrainte aussi rigide, comment cela transforme-t-il la façon dont on structure et pilote les organisations ?

- Projets collectifs et engagement sociétal : l’entreprise peut-elle réinvestir ce temps au service de causes plus larges, en favorisant l’innovation sociale et la co-construction avec ses parties prenantes ?

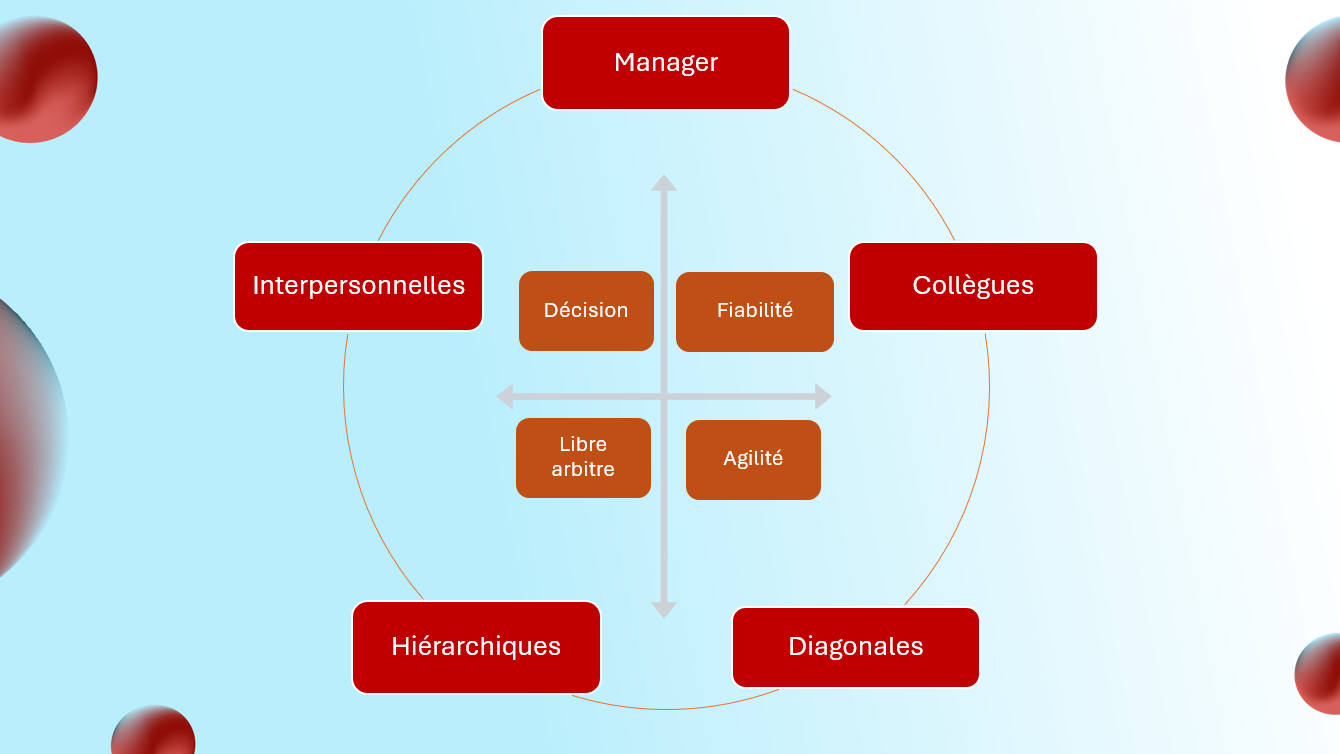

- Nouveaux modèles de gouvernance : la libération du temps ouvre-t-elle la voie à des formes plus horizontales/diagonales de prise de décision, où les collaborateurs ont un rôle accru dans l’orientation stratégique des entreprises ?

En filigrane, cette réflexion touche à la manière dont nous concevons le travail lui-même : doit-il rester un cadre structurant de nos sociétés ou devons-nous explorer des alternatives, comme la réduction du temps de travail, le travail collaboratif ou l’émergence d’activités hybrides entre production et engagement social ?

L’incertitude et l’improbable : comment préserver la sérendipité ?

Un autre point soulevé concerne la place de l’inattendu et de la disruption. L’IA, en optimisant nos processus, risque paradoxalement de réduire la part d’aléatoire et de surprise dans nos prises de décision. Or, l’innovation naît souvent de l’inattendu, des erreurs et des bifurcations imprévues.

Cette réflexion rejoint un débat plus large : l’hyper-structuration des activités par l’IA et l’analyse prédictive ne risque-t-elle pas d’appauvrir la créativité et la diversité des idées ?

L’enjeu ici est de trouver un équilibre entre :

- L’optimisation permise par l’IA en automatisant les tâches.

- La préservation de l’imprévu et de l’expérimentation, qui restent essentiels à l’innovation.

Imaginer de nouveaux usages transformateurs de la société

La conclusion de cette diapositive, qui évoque la nécessité de créer des espaces SAFE de l’IA, ouvre une perspective ambitieuse : au lieu de subir l’évolution technologique, les entreprises et les organisations ouvrir des espaces de réflexion et d’expérimentation sur les usages sociétaux de l’IA.

Cette approche repose sur plusieurs axes :

- Explorer des modèles de travail plus flexibles et plus inclusifs.

- Encourager des initiatives où l’IA est au service de projets à impact social ou environnemental.

- Préparer les individus à mieux interagir avec ces nouvelles technologies, en intégrant des formations adaptées et une sensibilisation au numérique éthique.

En définitive, nos échanges posent une réflexion qui dépasse le simple cadre de l’entreprise pour interroger notre rapport collectif au temps et à la valeur du travail.

Une Redéfinition de la Contribution Sociétale

En posant la question “Que fait-on du temps pour la société ?”, la diapositive ouvre une réflexion plus large sur la responsabilité des entreprises et des individus face à ces mutations. Si le travail humain perd progressivement sa centralité dans la production de valeur, comment redéfinir la contribution des organisations et des citoyens au bien commun ?

Plusieurs pistes émergent :

- Repenser le rôle des entreprises au-delà de la simple création de richesse. Dans un monde où l’IA et l’automatisation réduisent le besoin de travail humain, les entreprises doivent-elles prendre une part active dans l’éducation, l’innovation sociale et la préservation de l’environnement ? Comment gérer le dilemme entre l’IA réductrice de mobilités polluante et son impact carbone ?

- Expérimenter de nouveaux modèles d’organisation du temps. La réduction du temps de travail, le développement du temps libre productif (bénévolat, recherche, engagement citoyen) pourraient devenir des alternatives crédibles à un modèle où le travail rémunéré reste le principal indicateur de contribution à la société.

- Réfléchir à la place des collaborateurs dans ce nouveau paradigme. Si le travail humain n’est plus la mesure principale de la valeur économique, quelles nouvelles formes de reconnaissance et de rémunération peut-on imaginer ?

En définitive, cette réflexion rejoint une interrogation plus large sur notre rapport au progrès : voulons-nous d’un monde où la technologie optimise le temps de travail au détriment du sens et de la créativité, ou cherchons-nous à libérer du temps pour réinventer la manière dont nous vivons, travaillons et interagissons en société ?

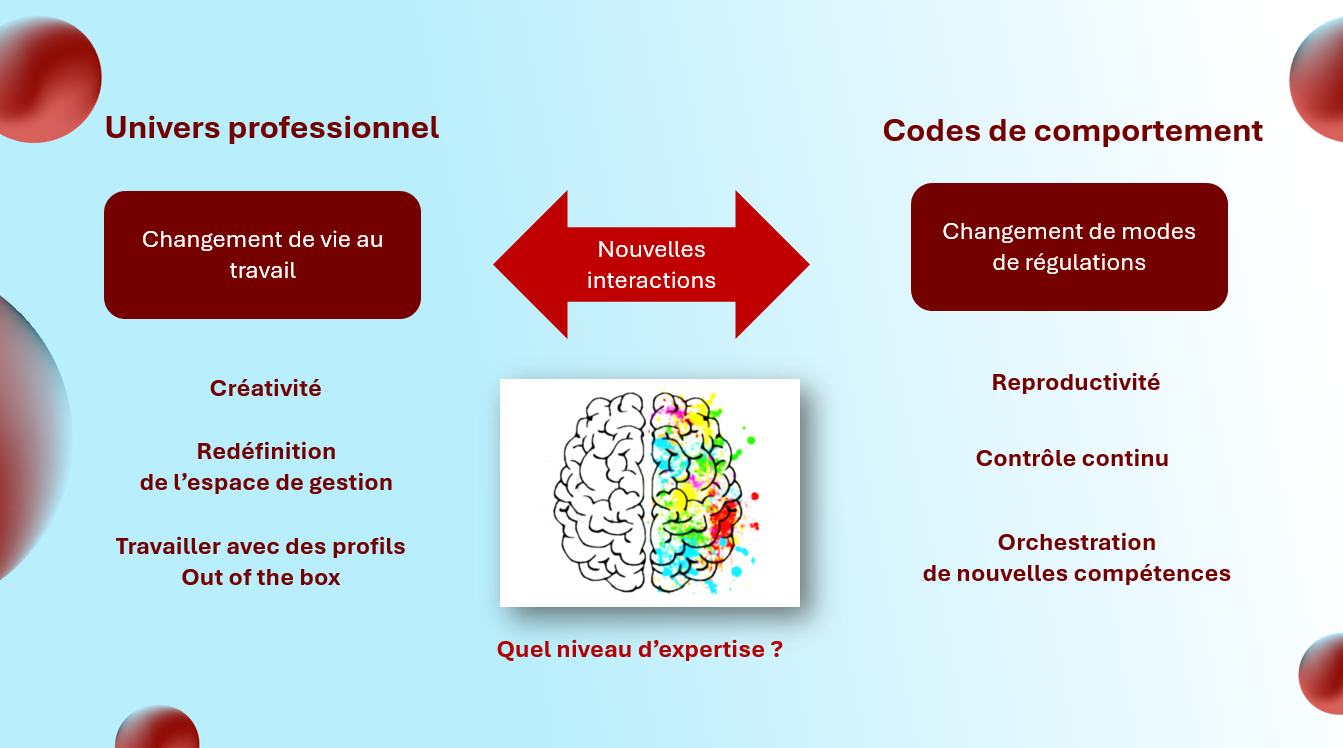

Mettre à l’épreuve les relations humaines

L’IA redéfinit en profondeur les dynamiques relationnelles au sein des organisations et dans la société en général. L’IA ne se limite pas à une transformation technologique, mais engage un véritable changement dans la manière dont les individus interagissent, collaborent et prennent des décisions.

Une Médiation Inédite entre les Humains

Traditionnellement, les relations humaines au sein des entreprises reposaient sur des échanges directs, des négociations interpersonnelles et une communication émotionnelle. L’IA introduit une nouvelle médiation dans ces interactions :

- Elle filtre et analyse les informations avant qu’elles ne parviennent aux individus. Par exemple, des algorithmes peuvent prioriser des e-mails, suggérer des décisions ou même modérer des discussions en ligne. Cette interposition modifie notre manière de percevoir et d’interagir avec les autres.

- Elle prend en charge des processus décisionnels. Dans certaines organisations, l’IA assiste, voire remplace, les managers dans la gestion des ressources humaines, la sélection des candidats ou l’évaluation des performances. Cela peut rationaliser les décisions, mais aussi créer une distance entre les collaborateurs et leur hiérarchie.

Si cette médiation permet de fluidifier certaines tâches, elle pose aussi un défi majeur : la confiance. Comment s’assurer que les choix effectués ou suggérés par l’IA ne sont pas biaisés ? Quelle place reste-t-il pour l’intuition, l’empathie et l’expérience humaine ?

Une Érosion du Lien Social ?

L’un des risques majeurs de l’automatisation croissante des interactions est la dilution du lien social dans les organisations. Plusieurs phénomènes peuvent en découler :

- Une diminution des interactions directes. Lorsque des chatbots, des assistants vocaux ou des systèmes automatisés prennent en charge la communication interne et externe, les opportunités d’échange humain se raréfient. Or, ces interactions informelles sont essentielles pour créer du lien, de la solidarité et une culture commune.

- Une perception de déshumanisation. Lorsqu’un employé reçoit une notification générée par une IA lui annonçant un changement dans son travail, l’absence d’interlocuteur humain peut renforcer un sentiment d’isolement et d’inhumanité dans la gestion des ressources humaines.

- Une augmentation des malentendus. L’IA traite des données et optimise des processus, mais elle ne capte pas pour l’instant les nuances émotionnelles et contextuelles des relations humaines. Une analyse algorithmique d’un conflit professionnel ne remplacera jamais une discussion en face-à-face pour comprendre des tensions sous-jacentes.

Face à ces risques, il devient crucial de préserver des espaces d’échanges directs authentiques au sein des organisations, en s’assurant que l’IA reste un outil de facilitation et non un facteur de distanciation.

L’IA comme Facteur de Discrimination et de Biais

Un autre enjeu fondamental est celui des biais algorithmiques. L’IA, bien qu’apparaissant comme un outil neutre, est influencée par les données sur lesquelles elle est entraînée. Cela peut entraîner :

- Des discriminations dans les processus de recrutement et d’évaluation. Si une IA est entraînée sur des bases de données biaisées, elle risque de reproduire, voire d’accentuer, ces inégalités (par exemple, en favorisant certains profils plutôt que d’autres).

- Une uniformisation des décisions. L’intelligence artificielle s’appuie sur des modèles de prédiction, ce qui peut conduire à un formatage des comportements et des choix, au détriment de la diversité des points de vue et des initiatives originales.

- Un risque de surveillance accrue. Les outils d’IA peuvent être utilisés pour analyser le comportement des employés en temps réel (suivi des performances, reconnaissance faciale, analyse de la productivité). Cette hyper-rationalisation peut créer un climat de défiance en augmentant pression.

La question devient alors : comment garantir que l’IA renforce la justice sociale plutôt que d’exacerber des inégalités existantes ? Cela implique une réflexion éthique et une régulation adaptée pour éviter que les relations professionnelles ne deviennent entièrement régies par des logiques algorithmiques.

Un Impact sur la Prise de Décision et la Responsabilité

L’introduction massive de l’IA dans la gestion des relations humaines transforme aussi la manière dont les décisions sont prises :

- Une délégation croissante de la responsabilité. Si un algorithme recommande un licenciement ou une promotion, qui est responsable en cas d’erreur ? La machine ? L’humain qui a validé la décision ? Cette dilution de la responsabilité peut compliquer la gouvernance des entreprises.

- Une remise en question du leadership humain. Dans un monde où les décisions sont de plus en plus basées sur des analyses de données, le rôle du manager évolue : doit-il se fier à son intuition ou suivre aveuglément les recommandations de l’IA ? Cette tension pose la question de la légitimité du pouvoir et de l’expertise humaine face aux décisions algorithmiques.

Si l’IA peut apporter des gains d’efficacité, elle ne doit pas priver les individus de leur capacité d’agir et de décider en conscience. L’avenir du management reposera sans doute sur un équilibre entre l’apport des technologies et la préservation d’une prise de décision pleinement assumée par les humains.

Vers un Nouvel Humanisme Numérique ?

Plutôt que de voir l’IA comme une menace pour les relations humaines, cette transformation pourrait être envisagée comme une opportunité de redéfinir ces relations sur de nouvelles bases :

- Réinvestir la place de l’humain dans les interactions. Si certaines tâches peuvent être automatisées, cela devrait libérer du temps pour des échanges de meilleure qualité, axés sur l’écoute et la créativité.

- Repenser les organisations pour intégrer une IA éthique et bienveillante. Plutôt que d’imposer l’IA comme une simple logique d’optimisation, elle pourrait être conçue comme un levier d’inclusion, de transparence et de justice sociale.

L’IA met à l’épreuve les relations humaines, mais elle nous oblige aussi à repenser ce qui fait la richesse des interactions entre individus. Face aux risques de déshumanisation, l’enjeu n’est pas de rejeter ces outils, mais de les orienter vers des usages qui renforcent la confiance, l’équité et la coopération au sein des organisations et de la société.

13 mars 2025 : Moma-COM